Desinformación con esteroides: la era de los deepfakes y la posverdad

Junio 2025

Gerardo de la Cruz Alegría

¿Estás seguro de que el video que acabas de ver en tu celular es completamente real? Bueno, pues si creíste que el canguro sosteniendo un boleto de avión era tierno y también real, déjame decirte que estás equivocado. La llegada de la Inteligencia Artificial (IA) trajo consigo un boom en la creación de contenido falso, pero con un alto grado de realismo. Esto es conocido como deepfake, que no es más que videos, imágenes o sonidos (como voces) generados con Inteligencia Artificial, entrenada con miles de registros visuales o auditivos hasta lograr imitaciones casi perfectas.

Ahora bien, deberíamos preguntarnos: ¿cómo nos sentimos con el exceso de información que llega a nosotros? Yo creo que sí vale la pena hacernos esa pregunta. En esta economía de la atención, todos están peleando por lo mismo: capturar unos segundos de tu mirada, que le hables a la IA, que le des clic a un video, que te quedes un rato más en la app… todo con tal de mostrarte un anuncio más o cobrarte una suscripción.

El problema es que esta sobrecarga informativa no sólo cansa, también distorsiona. En este contexto se ha popularizado el concepto de posverdad, un término que describe situaciones en las que los hechos objetivos tienen menos influencia en la opinión pública que las emociones o creencias personales. Las emociones pesan más que los hechos. Es más importante cómo nos hace sentir algo, que si es verdadero o no. Y eso, en combinación con herramientas tan potentes como los deepfakes, puede ser muy peligroso.

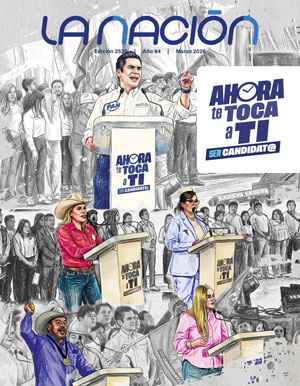

Por ejemplo, un deepfake puede hacer que la imagen del Sumo Pontífice vestido “a la moda” se vuelva viral, que la cara de alguien aparezca en una actividad que nunca hizo o incluso que te llame por teléfono, a viva voz, el presidente (falso obviamente). Es este tipo de cosas turbias lo que preocupa por el uso de estas herramientas para influir en las masas. Se puede manipular al electorado haciendo creer que un candidato dijo algo que jamás pensó con tal de generar un sentimiento negativo. Lo peor es que, aunque luego se demuestre que es falso, el daño ya está hecho. Imaginemos que sucede un día antes de la elección, en este caso podría influir de manera directa en los resultados de la misma.

Por ejemplo, en enero de 2024 se registró el primer caso documentado de una robocall con voz falsa de Joe Biden, pidiendo a los demócratas de Nuevo Hampshire que no votaran en las primarias. El responsable fue multado con 6 millones de dólares por manipular la elección con IA generativa.

Y también está el otro extremo: en donde hay tantos deepfakes y noticias falsas que la realidad se vuelve difusa, generando cinismo. El mejor ejemplo es el auge de los gobiernos populistas cínicos de los últimos años. Mientras desmantelan instituciones y aplican leyes a conveniencia, el electorado sigue creyendo en ellos sólo porque dicen representar al “pueblo bueno” y acusan a sus críticos de ser “los corruptos”. En un mundo donde todo puede ser falso, ya nada parece importar.

Como hemos visto los marcos regulatorios de la Unión Europea y Estados Unidos han tomado la delantera, mientras que países como México aún carecen de leyes específicas para contenido generado por IA. Pero la legislación no basta, necesitamos alfabetización digital urgente para reconocer señales de manipulación, fomentar pensamiento crítico y defendernos en este entorno de desinformación.